L’IA générative bouleverse-t-elle les pratiques pédagogiques ?

- Rendu public par OpenAI en 2023, GPT-4 a atteint des niveaux de performance comparables à ceux d’étudiants de second cycle sur des exercices de logique, de mathématiques et de rédaction académique.

- Les modèles de langage modifient la manière dont les étudiants mobilisent leur raisonnement et leur capacité analytique, ce qui peut mener à une fragilisation de leur plasticité cérébrale et de leur densification des réseaux neuronaux.

- Lorsque assisté par l’IA, l’acquisition des connaissances peut être affaiblie dès qu’elle remplace systématiquement l’effort intellectuel : les productions écrites, le travail autonome et les modalités d’évaluation.

- De nombreuses questions sur l’équilibre entre assistance algorithmique et effort cognitif humain sont soulevées, d’autant par la rapide évolution des modèles d’IA.

- Des cadres commencent à émerger où l’IA n’est ni absente ni centrale, mais intégrée de manière différenciée selon les objectifs cognitifs poursuivis.

L’irruption de l’intelligence artificielle générative dans les systèmes éducatifs marque un tournant technologique. Contrairement aux plateformes d’apprentissage en ligne ou aux outils d’assistance pédagogique des années 2000 et 2010, les modèles de langage de grande taille produisent désormais des raisonnements structurés, synthétisent des corpus complexes et interagissent avec les apprenants de manière adaptative.

GPT‑4, rendu public par OpenAI en 2023, a atteint des niveaux de performance comparables à ceux d’étudiants de second cycle sur des exercices de logique, de mathématiques et de rédaction académique1. D’autres architectures comme Claude d’Anthropic ou LLaMA de Meta confirment cette dynamique tout en explorant des stratégies de gouvernance des sorties génératives et de réduction des biais2.

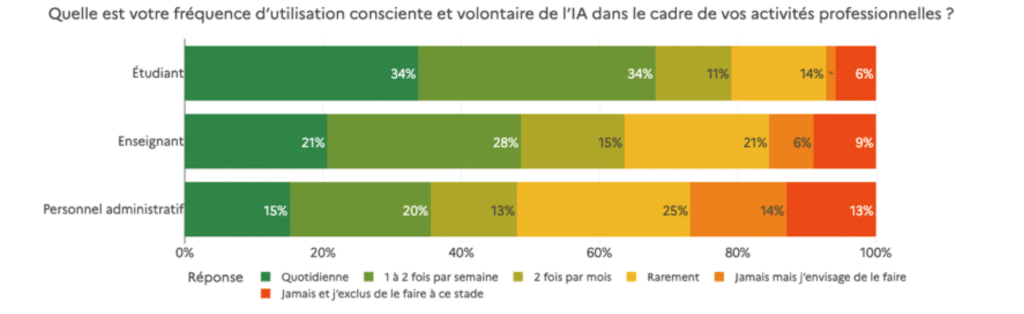

Ces avancées offrent de nouvelles opportunités pour personnaliser les parcours, renforcer le tutorat individualisé et élargir l’accès aux ressources pédagogiques. Elles soulèvent toutefois des interrogations sur les fréquences d’utilisations (voir figure 1) et les conditions cognitives de l’apprentissage assisté par IA, car certaines dimensions de l’acquisition des connaissances peuvent être fragilisées lorsque cette technologie remplace systématiquement l’effort intellectuel3.

Ces enjeux touchent directement des dispositifs clés de l’enseignement supérieur, tels que la production écrite, le travail autonome et les modalités d’évaluation. De plus, ces transformations appellent une approche combinant recherche académique et observation des pratiques pédagogiques.

L’effort cognitif à l’épreuve des modèles génératifs

Les modèles de langage de grande taille modifient la manière dont les étudiants mobilisent leur raisonnement et leur capacité analytique. GPT‑4, par exemple, atteint des performances comparables à celles d’étudiants de second cycle sur des exercices de logique, de mathématiques et de synthèse textuelle5. Cette portée soulève des questions sur l’équilibre entre assistance algorithmique et effort cognitif humain.

« Le problème, dans le champ éducatif, apparaît lorsque l’étudiant utilise systématiquement l’IA pour réaliser un exposé, un mémoire, une dissertation ou même pour apprendre une notion » affirme Michel Barabel, maître de conférences à l’Université Paris-Est dont les travaux portent sur la transformation des organisations, en particulier la gestion des compétences, la formation professionnelle et les cultures apprenantes. La sous-traitance systématique peut nuire au développement de capacités cognitives essentielles. « Les travaux de recherche montrent que dans ce cas, le coût de l’effort cognitif augmente rapidement et que faire seul devient de plus en plus difficile ».

Les cadres théoriques de la psychologie cognitive permettent d’éclairer ce phénomène. Les distinctions de Daniel Kahneman entre le cerveau de type 1, analytique et paresseux, et le cerveau de type 2, créatif et mobilisé dans la résolution de situations inédites, servent de référence. Barabel observe que « la grande promesse de l’IA est précisément de sous-traiter les tâches relevant du cerveau de type 1, simples et répétitives, afin de libérer du temps pour des activités de type 2 ». Son usage répété dans des tâches fondamentales du type 1 peut ainsi limiter la densification des réseaux neuronaux nécessaires à la créativité et à la pensée critique.

Une comparaison avec d’autres usages technologiques illustre ce risque. « Cette dépendance pose une question centrale, celle d’un appauvrissement progressif des capacités cognitives », explique Barabel, faisant référence à des exemples observés dans d’autres contextes, comme la navigation des chauffeurs de taxi londoniens devenue dépendante du GPS. Les travaux en neurosciences montrent que l’apprentissage reposant sur un engagement cognitif actif favorise la plasticité cérébrale et la densification des réseaux neuronaux, tandis qu’une réduction durable de l’effort analytique limite ces mécanismes et fragilise la mobilisation des compétences dans des situations complexes6. « Or, on sait qu’il est très difficile de faire émerger une créativité authentique sans ce socle d’effort cognitif préalable », ajoute l’expert.

Cette réflexion sur l’effort cognitif souligne que les effets de l’IA générative dépendent moins de la technologie que des modalités d’usage. L’usage réfléchi et régulé peut soutenir la créativité et la productivité, tandis qu’un usage passif peut compromettre le développement de compétences intellectuelles essentielles.

Des recours pédagogiques en recomposition progressive

La diffusion rapide des outils d’IA générative a rendu visibles des usages déjà largement installés chez les étudiants, souvent en dehors de tout cadre institutionnel. Plusieurs travaux montrent que ces outils sont mobilisés pour rédiger des exposés, structurer des mémoires ou préparer des évaluations, sans que les dispositifs pédagogiques aient été conçus pour en tenir compte7. Cette situation a conduit certains établissements à repenser non pas seulement la régulation, mais la nature même des activités proposées.

D’après Michel Barabel, « la question ne peut se réduire à une opposition entre autorisation et interdiction. Le problème ne doit pas être posé en ces termes ». Il stipule que l’IA combine des potentialités pédagogiques fortes et des limites réelles. Dans les dispositifs qu’il observe, l’enjeu consiste à distinguer plusieurs formes d’activités selon le rôle attribué à la machine. « Certaines activités peuvent être totalement confiées à l’IA sans régulation particulière », notamment lorsqu’il s’agit de procédures ou d’aide méthodologique, tandis que d’autres doivent rester exclusivement humaines. « L’usage de l’IA y est interdit afin de préserver la relation pédagogique, le travail du cerveau de type 1 et la créativité et l’esprit critique ».

Cette différenciation se traduit concrètement par des dispositifs de transparence. « À Sciences Po et à l’IAE Paris-Est, les étudiants doivent expliciter leur usage de l’IA dans une annexe dédiée. Nous autorisons son exploitation, mais nous imposons une annexe IA dans tous les travaux », précise Barabel. Cette exigence permet de déplacer l’évaluation du seul résultat vers le processus intellectuel mobilisé. « Le nouveau plagiat, pour nous, n’est pas d’utiliser l’IA, mais de l’utiliser sans le déclarer », ajoute-t-il.

Les modalités d’évaluation ont également été ajustées pour tenir compte de ces pratiques. Barabel observe qu’« un exposé à rendre pour la semaine suivante a aujourd’hui une probabilité très élevée d’être produit à 60, 70, voire 90 % à l’aide de l’IA ». Dans ce contexte, « là où l’écrit pesait auparavant davantage, l’oral est désormais majoritaire », afin de vérifier la compréhension, l’appropriation des concepts et la faculté de l’étudiant à défendre son raisonnement.

Entre délégation, assistance et augmentation, les applications pédagogiques se structurent ainsi autour d’un principe d’articulation. « Il existe des situations où l’IA assiste l’étudiant », note Barabel, tandis que dans d’autres configurations, « l’étudiant produit une première version et l’IA l’aide à l’améliorer par questionnement et suggestions ». Ces expérimentations dessinent progressivement un cadre où cette technologie n’est ni absente ni centrale, mais intégrée de manière différenciée selon les objectifs cognitifs poursuivis.

Entre promesses d’augmentation et risques de fragmentation

Les limites actuelles de l’IA générative en contexte éducatif tiennent moins à ses performances techniques qu’aux effets systémiques qu’elle induit sur les trajectoires d’apprentissage. Les bénéfices cognitifs observés dépendent fortement des conditions d’emploi, avec des résultats parfois contradictoires selon les protocoles expérimentaux[8]. Michel Barabel invite ainsi à la prudence dans l’interprétation des premières données disponibles. « Certaines études, notamment du MIT, ont montré une baisse rapide de certaines capacités cognitives, mais sur des échantillons très réduits et avec des protocoles discutables », rappelle-t-il, tout en notant que d’autres travaux mettent en évidence des effets positifs sur certaines compétences.

Cette hétérogénéité des résultats renvoie à une question centrale, celle de l’intensité et surtout de la nature des utilisations. « Il pas certain qu’il existe un seuil universel », précise Barabel, en soulignant que « le problème réside davantage dans l’organisation des activités que dans le volume d’interaction avec l’IA ». Il propose un équilibre théorique dans lequel « le 100 % humain devrait représenter au moins 20 % des activités », afin de préserver les fonctions cognitives fondamentales liées à l’effort, à la réflexion autonome et à la construction du jugement.

Cette réflexion sur l’effort cognitif souligne que les effets de l’IA générative dépendent moins de la technologie que des modalités d’usage

Au-delà des effets individuels, les chercheurs s’inquiètent de dynamiques d’inégalités susceptibles d’être amplifiées par les systèmes intelligents. Les écarts d’accès aux versions les plus performantes des modèles, souvent conditionnés par des abonnements payants, constituent un premier facteur de différenciation[9]. Barabel met en évidence le fait que « le capital économique des familles pourrait conditionner l’accès à des IA plus performantes, utilisées dans un cadre privé », créant un avantage cumulatif pour certains étudiants. À cela s’ajoutent les disparités institutionnelles. « Certains établissements disposent des moyens financiers et pédagogiques pour déployer des IA, former les enseignants et mettre en place des chartes éthiques. D’autres non ».

Ces écarts matériels se doublent d’inégalités culturelles et cognitives. « Le risque majeur est alors l’accroissement des écarts entre étudiants », pointe Barabel, distinguant ceux qui utilisent l’IA de manière stratégique, ceux qui en font un usage mécanique et ceux qui réinvestissent le temps libéré dans des activités à forte valeur cognitive. Les recherches en sociologie de l’éducation montrent que ces mécanismes d’appropriation différenciée jouent un rôle déterminant dans la reproduction ou la transformation des hiérarchies scolaires8.

Enfin, la rapidité d’évolution des technologies pose un défi structurel aux institutions éducatives. « Ce que nous disons aujourd’hui peut être remis en cause dans quelques mois par une nouvelle génération d’IA », signale Barabel. Cette instabilité technologique interroge la capacité des systèmes éducatifs à articuler innovation, équité et développement des compétences humaines fondamentales, dans un contexte où la production et la transmission des savoirs sont elles-mêmes en profonde recomposition.

Aicha Fall

https://www.enseignementsup-recherche.gouv.fr/sites/default/files/2025–07/rapport-intelligence-artificielle-et-enseignement-sup-rieur-formation-structuration-et-appropriation-par-la-soci‑t–37540.pdf↑