L’IA et le travail : la promesse de productivité au défi de la formation et de la cohésion sociale

- L'IA aurait le potentiel d’améliorer la productivité sans alléger la charge : les gains réels se réinvestissent en surcroît d'activité plutôt qu'en temps libéré.

- La même technologie peut augmenter les capacités humaines ou les substituer selon la façon dont elle est déployée.

- Les jeunes diplômés paient le prix fort, car les postes juniors disparaissent en premier, coupant la filière traditionnelle de transmission de l'expertise professionnelle.

- Un Plan Marshall de la formation est urgent. Réforme des curriculums, reconversion massive et investissement en capital humain comparable aux infrastructures IA.

- Comme la “pause d'Engels”, l'IA pourrait concentrer ses bénéfices chez quelques-uns — sauf à inventer de nouvelles solidarités et à orienter délibérément le progrès vers les travailleurs.

Rarement une technologie aura suscité simultanément autant d’enthousiasme et autant d’angoisse. D’un côté, des promesses de gains de productivité sans précédent depuis les années 1970 ; de l’autre, le spectre d’une compression des débouchés pour une génération entière de jeunes diplômés. Ces deux réalités ne sont pas contradictoires. Elles dessinent ensemble l’équation fondamentale de notre époque : l’IA est un amplificateur — de valeur pour ceux qui s’y préparent, d’inégalités pour ceux qu’on laisse de côté. Prendre la mesure de ce défi exige de suivre le fil qui va de la productivité à l’emploi, de l’emploi à l’organisation des entreprises, puis de l’organisation à une ambition collective de formation à la hauteur de l’enjeu. C’est ce parcours que cet article propose.

La productivité, une promesse qui commence à se matérialiser

Commençons par une bonne nouvelle : les signaux d’un choc de productivité réel commencent à s’accumuler. En janvier 2026, les économistes d’Apollo Global Management, conduits par Torsten Slok, recensent des hausses tangibles dans le DevOps, l’automatisation des processus et les fonctions support1. La synthèse la plus complète disponible à ce jour est celle du tableau de bord Early Signals of AI Impact, qui agrège en temps réel 303 sources — études académiques, rapports sectoriels, données de terrain — autour de 17 indicateurs de transformation du travail par l’IA : productivité individuelle, évolution du recrutement, recomposition des compétences demandées, restructuration des équipes. Son diagnostic de consensus est net : l’adoption des outils d’IA accélère dans l’ensemble des industries, la productivité mesurée dans les entreprises pionnières monte, et les postes d’exécution répétitive se compriment. La nuance décisive tient en un mot : les emplois changent plus vite qu’ils ne disparaissent, et aucun déplacement macroéconomique agrégé n’est encore mesurable. C’est précisément cet « encore » qui confère à la question de la préparation son caractère d’urgence2.

L’IA ne fait pas que remplacer des tâches : elle transforme le rythme même de l’innovation.

Mais l’IA ne fait pas que remplacer des tâches : elle transforme le rythme même de l’innovation. Bontadini, Haskel et leurs co-auteurs la décrivent comme une « méta-innovation » — une innovation dans la méthode d’innovation —, avec des effets multiplicateurs sur la productivité totale des facteurs dont l’économie américaine commencerait à peine à ressentir les effets, tandis que l’Europe accuse un retard d’adoption préoccupant3.

Pour autant, deux nuances s’imposent. La première tient au paradoxe de Moravec : l’IA excelle dans les tâches cognitivement complexes — rédaction, synthèse, code — mais reste maladroite dans les tâches manuelles contextuelles qui nous semblent faciles. Cet écart explique en partie le décalage entre le potentiel annoncé et l’adoption réelle dans l’économie4. La seconde nuance est encore plus contre-intuitive : selon une étude de la Harvard Business Review publiée en février 2026, l’IA n’allège pas la charge de travail — elle l’intensifie. Les salariés qui adoptent les outils IA traitent davantage de dossiers, répondent à plus de demandes, assument de nouvelles tâches. Le gain de productivité est réel, mais il ne se traduit pas automatiquement en temps libéré : il se réinvestit dans un surcroît d’activité5.

Autre enseignement décisif des travaux du NBER et du MIT : l’IA peut augmenter la productivité des travailleurs sans nécessairement automatiser des tâches entières. Cette distinction entre augmentation et automatisation n’est pas sémantique — elle conditionne l’ensemble des effets sociaux de la technologie. Dans le mode augmentation, l’IA devient une prothèse cognitive : elle étend les capacités de l’individu, lui permet de traiter plus de complexité, de produire plus vite, de mieux documenter ses décisions. L’emploi est préservé, souvent valorisé. Dans le mode automatisation, elle se substitue à l’activité humaine elle-même : l’emploi peut disparaître ou se transformer radicalement. Les deux modes coexistent dans la plupart des organisations — parfois au sein du même poste, selon les tâches et les moments6.

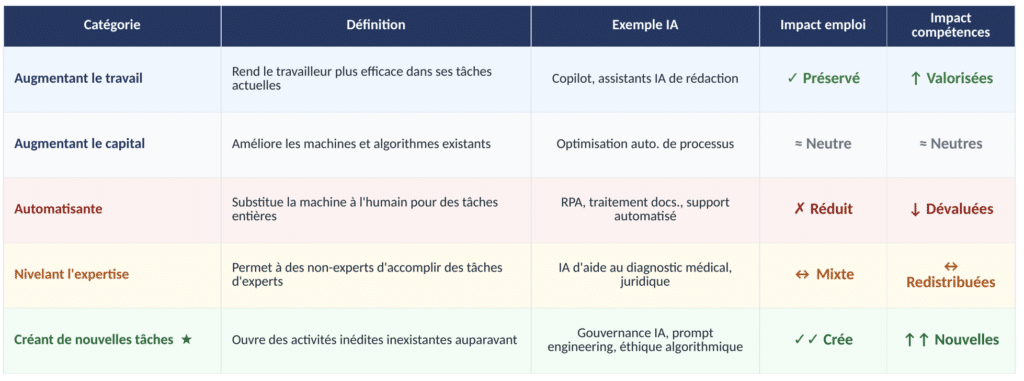

Acemoglu, Autor et Johnson affinent encore cette grille en distinguant cinq catégories de technologies, dont deux méritent une attention particulière. Les technologies de « nivellement de l’expertise » permettent à des non-experts d’accomplir des tâches autrefois réservées à des spécialistes — l’IA médicale d’aide au diagnostic en est un exemple. Les technologies de « création de nouvelles tâches » sont, quant à elles, les seules « sans ambiguïté favorables aux travailleurs » : elles génèrent une demande nette d’expertise humaine en ouvrant des activités qui n’existaient pas. C’est dans cette dernière catégorie que réside la promesse la plus solide — mais aussi la plus exigeante en termes de formation — de l’IA7.

L’impact sur les emplois : qui sont les canaris dans la mine ?

La métaphore choisie par Erik Brynjolfsson pour son étude de l’été 2025 est saisissante : dans les mines de charbon, on envoyait des canaris détecter les gaz toxiques avant que les mineurs n’entrent. Les jeunes travailleurs des secteurs exposés à l’IA sont, aujourd’hui, ces canaris8.

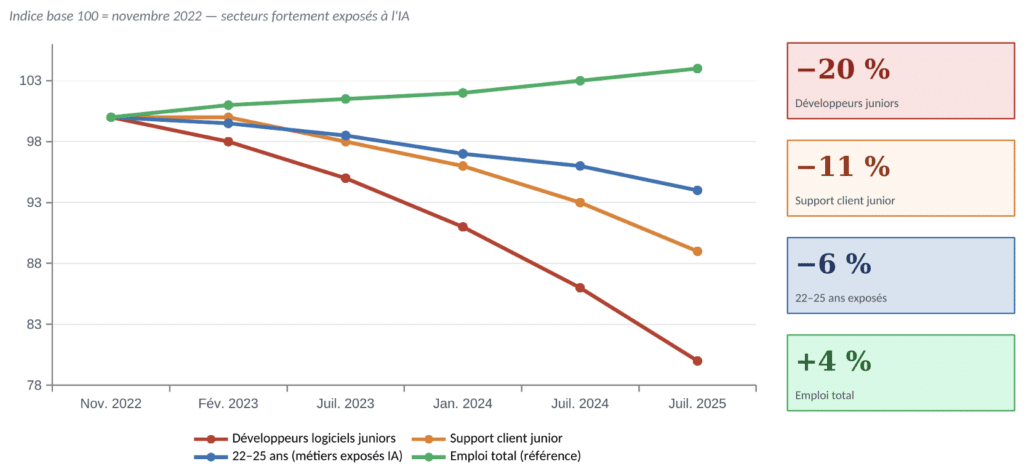

Les données ADP — les plus granulaires jamais mobilisées pour ce type d’analyse — sont éloquentes : aux États-Unis, entre fin 2022 et juillet 2025, l’emploi des 22–25 ans dans les métiers à forte exposition à l’IA a reculé de 6 %. Pour les jeunes développeurs logiciels, la chute atteint 20 % par rapport au pic de novembre 2022. Les fonctions support client d’entrée de gamme ont également perdu près de 11 % de leurs effectifs juniors. Ce sont les postes d’entrée qui s’évaporent en premier9.

Ce diagnostic résonne avec ce qu’observe le Financial Times dans son enquête sur la « grande sécheresse d’emplois pour diplômés » : des promotions entières sortent de bonnes universités et peinent à trouver des postes à la hauteur de leurs études, non parce que l’IA les a remplacés, mais parce qu’elle a rendu superflue la couche d’apprentissage par le bas que constituent les postes juniors10. La conséquence est perverse et mérite qu’on s’y arrête : si les jeunes n’acquièrent plus leur expertise sur le tas dans ces premiers emplois, la filière de transmission de l’expertise professionnelle est interrompue. L’IA peut amplifier l’expertise — mais elle ne peut pas la créer ex nihilo. Si la génération qui entre aujourd’hui sur le marché du travail ne construit pas ses fondations, qui formera les experts de 2035 ?

Il convient cependant de ne pas confondre exposition et destruction nette — et même de questionner la causalité. Autor lui-même souligne que le ralentissement de l’embauche dans les métiers exposés à l’IA commence au printemps 2022, soit avant la sortie de ChatGPT en novembre 2022 ; la hausse des taux directeurs de la Fed constitue une explication au moins aussi plausible11. Plus surprenant encore, le Budget Lab de Yale n’observe pas de différence significative entre les niveaux d’emploi dans les métiers les plus exposés à l’IA et les moins exposés — « the lines look the same », selon les propres termes de sa présidente. Ce que les métriques d’exposition capturent avec certitude, c’est une baisse des offres publiées dans les 40 % de métiers les plus exposés depuis l’essor de ChatGPT — ce qui n’est pas équivalent à des suppressions d’emplois nettes. L’économie dans son ensemble continue de créer des emplois ; c’est leur structure qui se transforme, et avec elle le contenu des compétences attendues12.

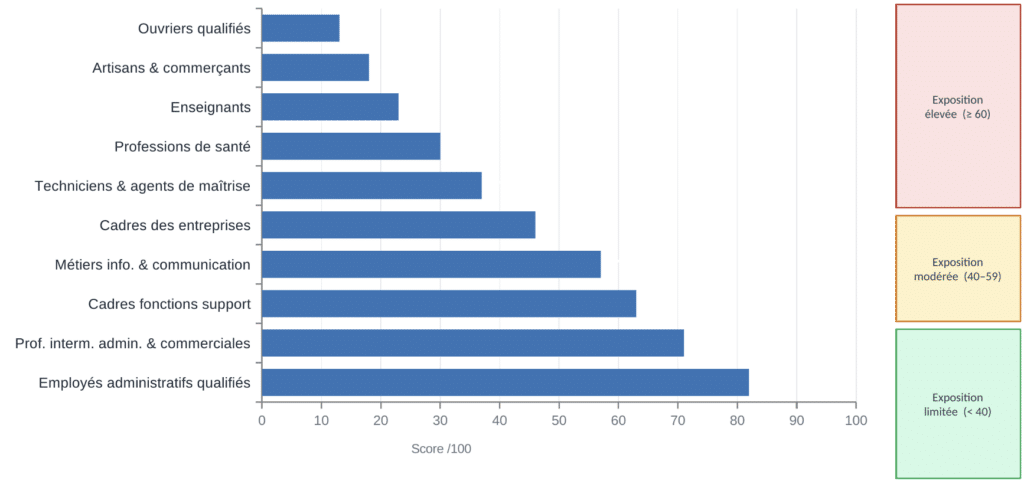

En France, le tableau est analogue. Les projections pour 2026–2030 identifient plusieurs catégories socio-professionnelles particulièrement vulnérables : les professions intermédiaires administratives, certains cadres des fonctions support, les employés de bureau qualifiés. La France n’est pas immunisée par son modèle social — elle est exposée, comme ses partenaires, à une recomposition accélérée de son marché du travail13.

David Autor offre une perspective plus nuancée et, à terme, plus optimiste : l’IA pourrait reconstituer de la valeur pour le travail qualifié en amplifiant ce que les humains font de mieux — le jugement, la relation, la créativité contextuelle. Elle pourrait même être le levier d’une reconstruction des emplois qualifiés de la classe moyenne, à condition que la technologie soit orientée vers l’augmentation des capacités humaines plutôt que vers leur substitution pure. Mais cette perspective suppose des politiques actives. Elle ne se matérialisera pas spontanément14.

L’entreprise face à l’IA : entre adoption hésitante et transformation profonde

Si les effets macroéconomiques restent à consolider, les effets de l’IA sur l’organisation interne des entreprises sont déjà perceptibles. La première leçon des études empiriques les plus rigoureuses est que les résultats dépendent bien moins de la technologie elle-même que des choix organisationnels qui l’accompagnent. Deux entreprises dotées des mêmes outils peuvent obtenir des résultats radicalement différents selon qu’elles ont repensé leurs processus, formé leurs équipes et redéfini les rôles ou non15.

Cette tension entre automatisation et augmentation est au cœur du rapport Beyond the Binary : les deux dynamiques coexistent et se combinent. Une même technologie peut automatiser des tâches routinières tout en augmentant la capacité d’action sur les tâches à forte valeur ajoutée. On identifie empiriquement trois profils d’adoption : les « cyborgs », qui intègrent l’IA de manière fluide dans leur flux de travail quotidien ; les « centaures », qui alternent entre travail autonome et délégation à l’IA selon la nature des tâches ; et les « auto-automatiseurs », qui programment l’IA pour prendre en charge des portions entières de leur activité. Ces trois modes n’ont pas les mêmes implications pour les compétences requises, les risques d’obsolescence ou les besoins de formation. La question n’est donc pas « L’IA remplace-t-elle ? » mais « Comment est-elle déployée, par qui, pour quels objectifs, et avec quels garde-fous ? »16

Les entreprises qui ont réussi à déployer une IA qui élève les compétences de leurs salariés l’ont fait délibérément, en refusant de laisser la seule logique d’automatisation dicter les choix d’architecture.

Une catégorie particulièrement scrutée est celle des managers intermédiaires. L’IA rend visibles des couches hiérarchiques dont la valeur ajoutée — transmission de l’information, coordination, reporting — est précisément celle que les systèmes automatisés peuvent désormais assumer17. Mais la fonction managériale ne se réduit pas à la circulation de l’information : elle inclut le développement des talents, la gestion des conflits, l’interprétation du contexte, la confiance dans les équipes — compétences que le McKinsey Global Institute identifie comme les grandes gagnantes de l’ère IA, dont la demande croît précisément parce que les LLMs ne savent pas les reproduire. Le manager de demain n’est pas celui qui filtre l’information — c’est celui qui crée du sens18.

Enfin — et c’est peut-être la leçon la plus importante — une IA favorable aux travailleurs ne se construit pas par défaut. Les recherches du MIT Sloan le montrent : les entreprises qui ont réussi à déployer une IA qui élève les compétences de leurs salariés l’ont fait délibérément, en refusant de laisser la seule logique d’automatisation dicter les choix d’architecture. Ce n’est pas un impératif moral abstrait : c’est une condition de performance durable, dans un contexte où la rétention des talents et la confiance interne deviennent des avantages compétitifs déterminants19. Acemoglu, Autor et Johnson vont plus loin : ce n’est pas seulement une question de choix d’entreprise, c’est une défaillance de marché documentée. Trois facteurs cumulatifs poussent structurellement l’industrie vers l’automatisation : la dépendance au sentier (les grandes firmes ont bâti leur modèle économique sur des outils d’automatisation dont elles tirent leur rentabilité) ; l’idéologie dominante dans les laboratoires de recherche, orientée vers l’AGI et peu sensible aux effets de travail ; et la concentration croissante du secteur, qui étouffe les modèles alternatifs. « We are not currently on the pro-worker AI path » — « nous ne sommes pas actuellement sur la voie d’une IA favorable aux travailleurs » — tranche Simon Johnson. Cette défaillance appelle des réponses qui dépassent la bonne volonté des entreprises20.

Pour un plan Marshall de la formation

Si l’IA comprime les postes d’entrée, elle fragilise le principal mécanisme par lequel les sociétés ont toujours transmis leur capital humain : l’apprentissage sur le tas. Toutes les typologies d’interaction humain-IA — des « cyborgs » aux « centaures » en passant par les « auto-automatiseurs » — supposent une expertise préalable que l’IA vient amplifier. Mais cette expertise se construit dans les premières années d’activité professionnelle, dans des postes juniors qui sont précisément ceux qui disparaissent. Le risque systémique est réel : en court-circuitant l’apprentissage d’entrée de carrière, l’IA risque de créer une génération de professionnels sans fondations solides — des édifices sans rez-de-chaussée21.

Ce diagnostic impose une réponse de l’ampleur d’un Plan Marshall. L’analogie n’est pas rhétorique : le plan de 1948 était une réponse collective et structurée à une destruction massive de capital physique. L’IA crée une destruction accélérée de capital humain — pas par la violence, mais par l’obsolescence. Les travaux d’Oxford sur le chômage technologique rappellent utilement que chaque grande vague d’automatisation a produit ses adaptations inattendues ; mais aucune vague précédente n’avait ce rythme ni cette portée transversale à l’ensemble des fonctions cognitives, du bas de l’échelle jusqu’aux professions les plus qualifiées22.

Les compétences ont une durée de vie de plus en plus courte, et les systèmes de formation continue ont été conçus pour un monde où l’obsolescence se comptait en décennies, non en années.

Trois chantiers s’imposent en parallèle. Le premier est la réforme des curriculums : des formations primaires aux grandes écoles, il faut intégrer non seulement les compétences d’interaction avec l’IA, mais surtout les aptitudes que les LLMs ne savent pas reproduire — jugement critique, argumentation, créativité contextuelle, intelligence relationnelle. Les travaux sur les compétences K‑12 à l’ère de l’IA montrent que cette réforme est faisable à grande échelle si on se donne les moyens de la priorisation23.

Le deuxième chantier est un programme massif de reconversion professionnelle, ciblé sur les 40 % de métiers les plus exposés. Les données granulaires du Budget Lab de Yale permettent de prioriser ces interventions avec une précision inédite. L’enjeu est de construire des parcours courts, certifiants, accessibles aux actifs en emploi, avec une gouvernance tripartite associant État, branches professionnelles et entreprises. La rapidité est ici décisive : les compétences ont une durée de vie de plus en plus courte, et les systèmes de formation continue ont été conçus pour un monde où l’obsolescence se comptait en décennies, non en années.

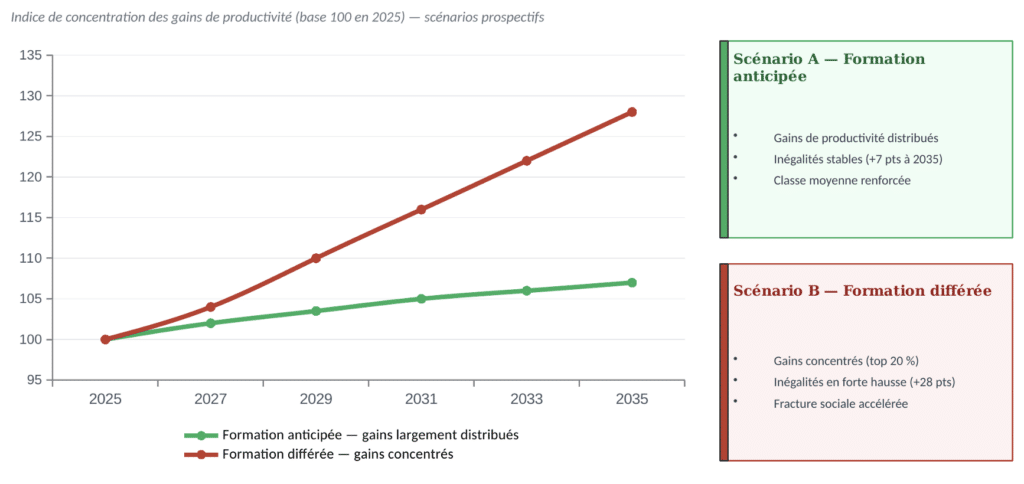

Le troisième chantier est financier. Les entreprises investissent des centaines de milliards dans l’infrastructure IA — data centers, puces, modèles de fondation. Un effort comparable sur le capital humain n’est pas seulement une obligation morale : c’est la condition de la soutenabilité sociale du modèle. Les scénarios économiques pour une IA transformatrice élaborés en février 2026 à Londres, dans le cadre d’un exercice prospectif réunissant des économistes et des décideurs autour de Windfall Trust et du Gresham College, l’illustrent avec précision : dans toutes les trajectoires où les gains de productivité se distribuent largement, l’investissement en formation a systématiquement précédé — ou accompagné — le déploiement technologique. L’opposé est tout aussi vrai : là où la formation a été différée, les bénéfices de l’IA se sont concentrés sur quelques acteurs, creusant les inégalités au lieu de les réduire24.

Ces trois chantiers — curriculums, reconversion et financement — sont nécessaires. Mais ils ne suffisent pas si l’on ne s’attaque pas au problème en amont : l’orientation de l’IA elle-même. Acemoglu, Autor et Johnson identifient trois leviers politiques complémentaires. Le premier est l’application du droit de la concurrence pour briser la concentration du secteur et ouvrir l’espace à de nouveaux entrants porteurs de modèles d’affaires moins tournés vers l’automatisation pure. Le deuxième est la protection juridique de l’expertise professionnelle : les travailleurs dont le savoir-faire est absorbé par les systèmes d’IA devraient disposer de droits sur cette contribution, comme une digue contre le « vol d’expertise »25. Le troisième est l’institutionnalisation de la voix des travailleurs dans les décisions de déploiement — au niveau de l’entreprise comme de la régulation sectorielle. Former les humains à s’adapter à l’IA est indispensable ; orienter l’IA vers les humains est tout aussi urgent26.

Face aux bouleversements sociaux, créer de nouvelles formes de solidarité

Ce plan de formation est donc indispensable pour ceux dont les compétences sont menacées par l’intelligence artificielle. Toutefois, l’histoire enseigne que les révolutions industrielles bouleversent les cadres sociaux traditionnels. Lorsqu’ils sont massifs, les gains de productivité ne sont pas une simple donnée statistique ; ils annoncent une profonde mutation structurelle.

Au XIXe siècle, la domestication de la puissance mécanique et thermique a brutalement évincé les paysans de leurs champs et déclassé des artisans au profit d’usines opérées par des ouvriers peu qualifiés. Ce processus a constitué un prolétariat urbain plongé dans la misère par la surabondance de l’offre de travail. Malgré une hausse spectaculaire du PIB, les conditions de vie ouvrière ont stagné pendant près d’un demi-siècle. C’est la « pause d’Engels »27, la période pendant laquelle l’élite industrielle a capturé l’essentiel de la richesse née des gains de productivité. Ce bouleversement est aussi caractérisé par une dévastatrice perte de repères sociaux : déplacements forcés, distension des solidarités familiales, effacement des hiérarchies traditionnelles du travail, rémunérations de subsistance. L’économie est alors « désencastrée » de la société, selon les termes de Polanyi28. La réaction intellectuelle et politique fut vigoureuse : du Capital de Karl Marx (1867) à la structuration des mouvements révolutionnaires et réformistes, un rapport de forces se construit entre le capital et le travail pour aboutir progressivement à la sécurité sociale moderne, sans le « grand soir » annoncé.

Cette fresque historique est évidemment simplifiée. La lente construction du pacte social ne fut ni naturelle, ni paisible. Elle a eu lieu sous la pression brutale des chocs politiques et géopolitiques : expansion coloniale, choc des impérialismes, révolution soviétique et guerres mondiales. Le pacte social a aussi longtemps reposé sur l’émergence d’emplois de repli dans les services, capables d’absorber les effectifs rendus inutiles dans l’agriculture et l’industrie. Douglass North souligne que la survie d’un tel système dépend de l’évolution de ses institutions pour gérer ces transitions29.

L’IA pourrait provoquer des mutations comparables à celles des révolutions industrielles

Parce qu’elle est cognitive, la révolution de l’IA se répandra plus rapidement que celle du moteur — ce qui rend l’intervention d’autant plus urgente : une « pause d’Engels » de 60 ans serait inacceptable au XXIe siècle, même raccourcie. Dans ses applications physiques, l’IA s’appuie sur des architectures de robots existantes ou reprogrammables dans des délais relativement courts. Comme l’électricité, l’IA est une technologie transversale susceptible d’accroître massivement la productivité de tous les secteurs. Tout est question de rythme de déploiement et d’impact réel mais le risque existe et doit être analysé et anticipé. L’IA pourrait provoquer des mutations comparables à celles des révolutions industrielles antérieures. Il s’agit plus d’une question de temps, en particulier dans une Europe qui a sous-investi dans la technologie et la R&D depuis plus de 10 ans. Par ailleurs, depuis 20 ans, la révolution de l’internet concentre les rentes chez un petit nombre d’acteurs capables d’investir massivement en capital industriel et humain. Cette accumulation de capital permet au Big Tech américain de se positionner aux avant-postes de l’IA, en acquérant les start-ups concurrentes, en recrutant les meilleurs talents et en préemptant les ressources électriques nécessaires au déploiement. Ces postures rappellent celles des oligopoles pétroliers de la deuxième révolution industrielle, finalement démantelés au début du XXe siècle.

Face au risque de déclassement, nous peinons à imaginer les futurs secteurs de repli. Même si le vieillissement de la population, l’éducation, les loisirs et la santé sont des thématiques d’emploi puissantes, elles sont aujourd’hui mal rémunérées et peu attrayantes. En parallèle, la technologie réactive les tensions géopolitiques : elle est, par exemple, une des causes fondamentales des frictions sino-américaines. Nous devons donc nous préparer à une double révolution — l’impact interne de la technologie dans nos productions et les effets externes d’une nouvelle répartition des richesses. Comme l’indiquent Acemoglu et Johnson30, après Korinek et Stiglitz31, l’ajustement ne sera probablement pas spontané et nécessite de « diriger » le progrès technique32. Cette position est contestée par ceux qui redoutent les risques de capture réglementaire ; elle n’en pose pas moins une question intéressante et qu’il est probablement nécessaire d’anticiper.

Il est donc prudent de travailler sur des paradigmes novateurs, notamment en termes d’institutions et de financement. Les options fréquemment proposées sont toutes en rupture avec les dispositifs existants : revenu universel, accès gratuit aux services publics, baisse volontaire de la productivité par la réduction du temps de travail. Il est trop tôt pour se prononcer mais il reste à financer ces programmes. Le sujet est simple en apparence, puisque la hausse de la productivité augmente l’assiette des richesses à répartir. On évoque des taxes sur les robots33 et le capital productif, voire sur les données, puisque la taxation du travail seule sera insuffisante34. Ou bien la constitution d’un très grand fonds de protection sociale, géré comme un fonds de pension abondé par des parts des nouvelles entreprises, en contrepartie de la fourniture des infrastructures sociales auxquelles elles devront leur succès — sur le modèle de l’Alaska Permanent Fund, qui redistribue aux citoyens une fraction des revenus pétroliers d’État, ou des propositions académiques de « fonds citoyen » développées par John Roemer et reprises par Daron Acemoglu. Dans la même veine, David Autor et Neil Thompson (MIT) proposent un « Universal Basic Capital » : chaque enfant recevrait à la naissance un portefeuille d’actifs productifs, lui conférant un droit permanent aux revenus du capital — y compris automatisé — sans dépendre de transferts budgétaires politiquement vulnérables. D’autres idées sont nécessaires, car les montants évoqués ici ne sont pas à la hauteur des enjeux. Ces propositions supposent de surcroît un consensus mondial en raison de la mobilité du capital et des entrepreneurs. Ce débat doit avoir lieu avant que des solutions indésirables ne nous soient imposées par une évolution du marché du travail où nous serions « agis » et non pas « agissants ».

L’économiste David Autor a cette formule : l’IA pourrait reconstruire la classe moyenne en amplifiant ce que les humains font de mieux. Brynjolfsson nous rappelle, données à l’appui, que pour l’instant, ce sont les plus jeunes qui paient le prix de la transition. Entre ces deux vérités, il n’y a pas de contradiction — il y a un agenda.

L’IA est un amplificateur. Elle amplifie la productivité des organisations qui s’y préparent ; elle amplifie les inégalités dans celles qui ne le font pas. Elle peut amplifier la valeur du jugement humain ; elle peut aussi amplifier la vulnérabilité de ceux qui n’ont pas accès à la formation. La vraie question n’est pas technologique. Elle est politique : avons-nous la volonté collective de faire de la formation une priorité aussi urgente que l’investissement en infrastructure numérique ? Et de trouver des solutions créatives et réalistes pour financer la transformation du système. La réponse à cette question déterminera si le dividende IA profite à quelques-uns — ou à tous.