IA : comment intégrer et évaluer l’éthique, la souveraineté et l’éco-responsabilité ?

- Avec l’émergence des nouvelles technologies, apparaissent de nos jours des approches éthiques de l’IA.

- L’IA éthique vise à intégrer dans le code de l’IA des recommandations éthiques, quand l’IA digne de confiance cherche plutôt à encadrer les décisions automatiques.

- L’Ethics by Design cherche à garantir la transparence et la clarté des systèmes d’IA ainsi que de leurs finalités ; elle doit être prolongée par l’Ethics by Evolution.

- L’Ethics by Evolution consiste à adapter continuellement les critères et indicateurs éthiques au long de la période d’apprentissage du système d’IA.

- Un objectif de l’Ethics by Evolution est d’accompagner les professionnels de la Tech vers le développement d’une technologie axée sur les humains.

Depuis toujours, les grandes avancées technologiques suscitent à la fois espoir et inquiétude, car leurs dérives reflètent avant tout celles des sociétés qui les produisent. La révolution numérique et l’essor de l’intelligence artificielle (IA) marquent toutefois une rupture inédite : pour la première fois, l’avenir de l’humanité se joue dans les lignes de code et dans des systèmes capables d’agir à grande échelle dans toutes les sphères de la société, à la fois dans la vie professionnelle et personnelle.

Le rythme fulgurant de ces innovations dépasse notre capacité collective d’anticipation et de régulation, touchant même l’aspect cognitif de l’être humain. Dans ce contexte d’incertitude civilisationnelle profonde, il devient essentiel de structurer et d’évaluer l’éthique des systèmes d’IA, afin d’orienter ces technologies au service de l’intérêt humain.

L’Ethics by Design et l’Ethics by Evolution

La société ne dispose pas encore de règles universelles réellement établies pour intégrer les valeurs humaines au cœur des systèmes d’IA. Bien que des initiatives se multiplient, comme le règlement européen AI Act rentré en vigueur le 1er août 2024, visant une IA digne de confiance, l’essor rapide du numérique rend urgente la définition d’un socle éthique et souverain commun. L’objectif est de garantir le sens, la sécurité, la transparence, l’éco-responsabilité, et la souveraineté des systèmes intelligents afin de renforcer la confiance dans leurs usages.

Dès lors, les concepteurs d’applications d’IA doivent, dès l’origine, intégrer les risques, les limites et les impacts sociétaux de leurs systèmes. Deux approches complémentaires peuvent être distinguées : l’« IA éthique », qui consiste à intégrer directement des principes, des mécanismes de raisonnement moral, et des recommandations éthiques dans le code afin de rendre la machine capable de décisions éthiquement fondées ; et l’« IA digne de confiance », qui vise surtout à encadrer et contrôler les décisions automatiques pour en assurer la conformité avec les valeurs collectives.

La première approche apparait plus structurante et évolutive, car elle permet d’inscrire l’éthique au cœur même de la conception et de l’évolution des systèmes, dans une logique d’Ethics by Design1 puis d’Ethics by Evolution2.

Les notions de « valeurs » et de « principes » moraux sont complexes et difficiles à traduire directement en structures de calcul. En revanche, il est plus opérationnel de les décliner en normes et règles explicites, c’est-à-dire en instructions et préconisations concrètes applicables dans des contextes définis : c’est ce que l’on peut appeler le processus de décodage puis d’encodage éthique de l’IA. Dans cette perspective, l’éthique doit être intégrée dès la conception des systèmes, en anticipant les dilemmes potentiels et en traduisant des principes partagés en règles incorporées au code. Compte tenu de l’autonomie décisionnelle et des capacités d’apprentissage des IA, cette intégration est essentielle pour garantir la transparence, la sécurité et la responsabilité des technologies numériques.

L’enjeu consiste à développer des algorithmes capables d’agir dans des contextes comportant des implications éthiques. Cette ambition fait émerger deux grandes catégories de risques : ceux liés aux défauts de conception et ceux qui découlent des mécanismes d’apprentissage. Donner du sens à l’IA suppose alors d’articuler trois dimensions complémentaires : l’orientation et la finalité, qui définissent la stratégie et la gouvernance des systèmes ; la signification, qui rappelle que l’IA doit rester un outil au service de la société – favorisant la complémentarité humain-machine – de l’explicabilité et de l’inclusion ; et enfin l’explication, qui engage une réflexion collective sur les finalités poursuivies et leur légitimité. La mise en œuvre d’un tel cadre éthique demeure toutefois complexe et soulève des interrogations incontournables.

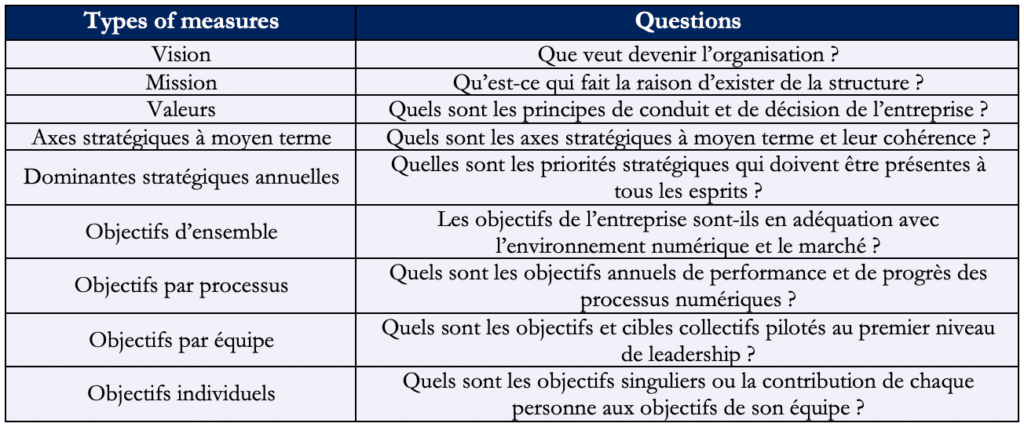

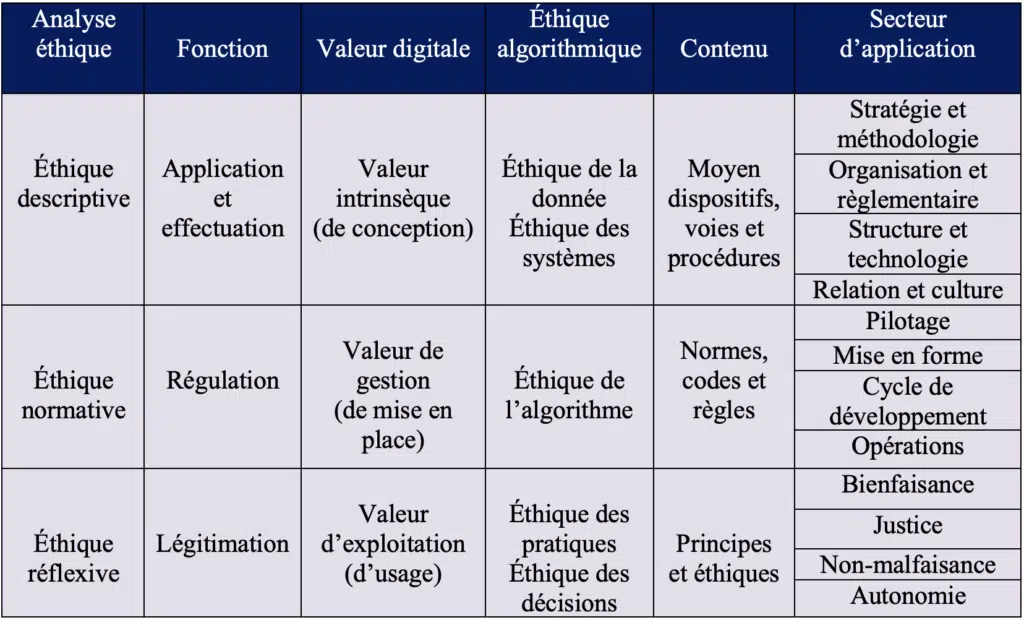

Tout l’intérêt d’un management éthique réside dans le fait d’apporter du sens et des finalités à l’organisation mise en place (voir tableau 1).

Ainsi, il apparait déterminant d’avoir une approche inclusive associant l’ensemble des parties prenantes dès la phase de conception des systèmes d’IA, afin de garantir transparence, explicabilité et clarté quant à leurs finalités : c’est le principe d’Ethics by Design. Cette démarche doit ensuite se prolonger tout au long du cycle de vie de l’IA – déploiement, usage et évolution – en adaptant continuellement les critères et indicateurs éthiques au rythme de l’apprentissage du système : c’est l’Ethics by Evolution.

L’éthique algorithmique

L’éthique appliquée au numérique réside dans l’intention tournée vers la finalité et le sens d’un système algorithmique. Elle peut se décliner en trois natures d’éthique (voir tableau 2)3 :

- Éthique descriptive : elle s’applique à la valeur intrinsèque (de conception). Elle constitue une éthique d’application et d’affectation sous forme de la pratique avec des moyens, dispositifs, voies et procédures mis en œuvre ;

- Éthique normative : elle concerne la valeur de gestion (de mise en place). Elle forme une éthique de régulation d’aspect déontologique via des normes, des codes et des règles mises en place ;

- Éthique réflexive : elle s’applique à la valeur d’exploitation (d’usage). Elle représente une éthique de légitimation basée sur le questionnement des fondements et des finalités via des principes et des valeurs humaines. L’articulation et l’agencement de ces trois familles d’éthique s’appliquent à l’ensemble du cycle de vie d’un système algorithmique (conception – mise en place – usage) pour alimenter notre Ethics by Evolution.

Une démarche d’inclusion éthique proactive, fondée sur l’implication des utilisateurs et l’interaction continue avec les systèmes d’IA, permet de renforcer progressivement la confiance, la fiabilité et la transparence des algorithmes. Si ces derniers sont souvent accusés de discrimination ou de biais, il convient toutefois d’interroger la responsabilité humaine : un algorithme reste un outil, façonné par les données qu’on lui fournit, les choix de conception et les usages que nous en faisons. Les véritables risques résident notamment dans les biais – cognitifs, statistiques ou économiques – qui peuvent s’inscrire, implicitement ou explicitement, dans les modèles et les rendre injustes ou malveillants. Cette réalité nous oblige à prendre du recul sur nos pratiques et à questionner le sens de notre trajectoire : construisons-nous réellement une « humanité digitale » à la hauteur de nos valeurs morales et sociétales ?

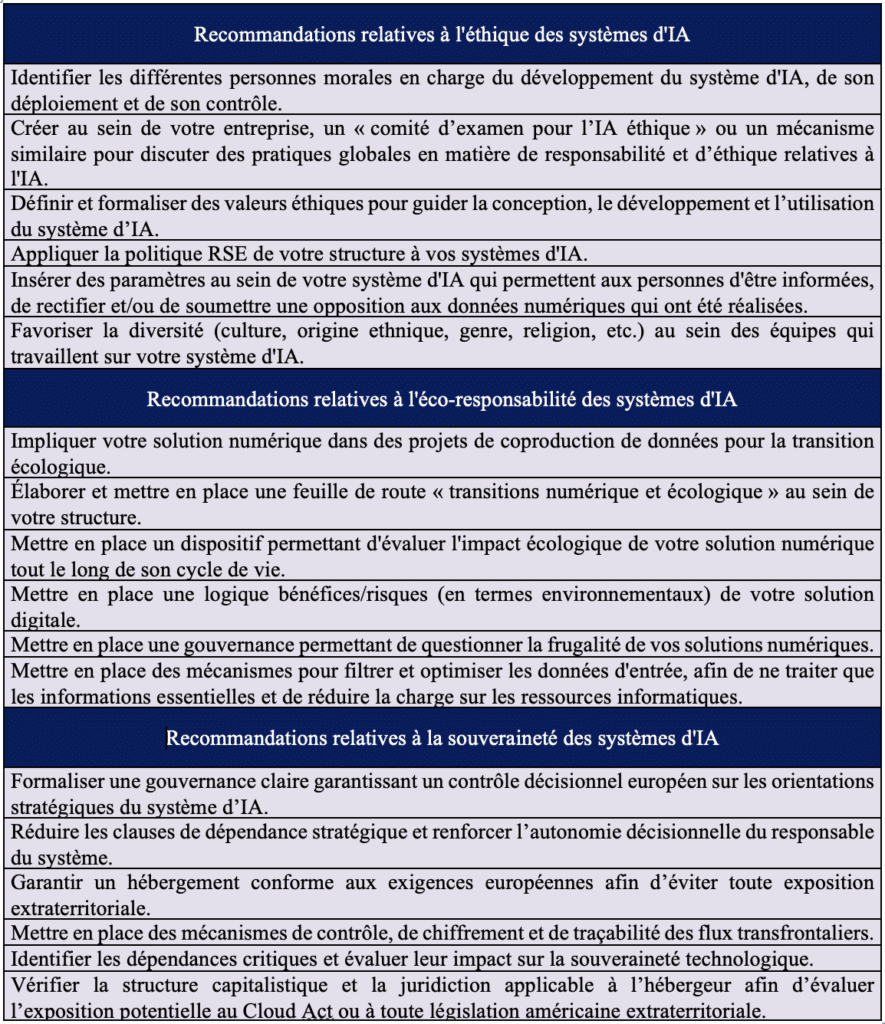

Dans ces conditions, il devient fondamental d’apporter des préconisations spécifiques relatives à l’éthique, l’éco-responsabilité, et la souveraineté des systèmes d’IA. On peut donner quelques exemples de mesures à mettre en place, comme dans le tableau 3 ci-dessous.

Enfin, il apparait indispensable d’accompagner les professionnels de la Tech vers une démarche de développement responsable, intégrant une forme d’intelligence émotionnelle et une conscience accrue des impacts humains de leurs travaux. C’est précisément l’ambition d’une approche Ethics by Evolution, conçue pour replacer l’humain au cœur de la technologie en évaluant chaque étape du cycle de vie d’un algorithme et en mesurant son niveau d’engagement éthique.

Cette approche s’articule en plusieurs phases. La première porte sur l’éthique du contexte : elle interroge les finalités du système, les conditions de sa conception, la nature et la représentativité des données utilisées, ainsi que la sensibilisation des équipes aux risques de biais et aux enjeux sociétaux. La deuxième phase consiste en une évaluation expérimentale du système, à travers l’analyse des données d’entrée et de sortie et la mesure d’indicateurs tels que la fiabilité, l’interprétabilité, la robustesse ou encore l’absence de discrimination. Enfin, une éthique des résultats assure un suivi continu de l’algorithme dans son usage réel, afin d’anticiper et d’ajuster son comportement.

En définitive, si l’IA porte des promesses majeures, elle comporte aussi des risques qu’il convient d’encadrer pour garantir sa conformité au droit, aux valeurs morales et au bien commun. Intégrer des critères éthiques dès aujourd’hui, malgré la complexité supplémentaire qu’ils impliquent, est une condition essentielle pour instaurer une véritable culture de l’éthique numérique et assurer sécurité, sens et confiance dans le traitement des données au sein des organisations et des territoires.